Comparacion De Estadisticas Y Machine Learning

La revolución de los datos ha traído consigo un debate que divide a profesionales y académicos por igual: ¿son las estadísticas y el machine learning dos caras de la misma moneda o disciplinas completamente diferentes? Esta Comparación De Estadísticas Y Machine Learning: Guía Clave te ayudará a entender no solo sus diferencias fundamentales, sino también cómo estas dos áreas se complementan en el desarrollo de soluciones con Python.

Si trabajas con datos, probablemente te has encontrado eligiendo entre un modelo estadístico tradicional y un algoritmo de aprendizaje automático. La decisión no es trivial y puede determinar el éxito o fracaso de tu proyecto.

Las Raíces del Conflicto: ¿Por Qué Existe Esta Confusión?

El machine learning existe desde hace décadas, pero fue inicialmente rechazado por sus enormes requisitos computacionales. Cuando las universidades tenían departamentos de estadística bien establecidos, el aprendizaje automático era apenas una promesa tecnológica.

Entonces, ¿por qué no vemos departamentos de estadística cerrando sus puertas para convertirse en centros de machine learning?

La respuesta es simple: no son lo mismo. Aunque comparten herramientas y fundamentos matemáticos, sus objetivos y enfoques difieren significativamente.

Muchos argumentan que el machine learning es simplemente “estadística glorificada”. Esta visión reduccionista ignora las diferencias fundamentales en metodología, propósito y aplicación práctica.

Entendiendo las Estadísticas: Más Que Números

Las estadísticas son la rama de las matemáticas aplicadas que se ocupa de recopilar, analizar, interpretar y presentar datos. Su objetivo principal es comprender las relaciones entre variables y extraer conclusiones válidas.

¿Cuándo fue la última vez que calculaste un intervalo de confianza en Python?

Las estadísticas se dividen tradicionalmente en dos áreas principales: descriptivas e inferenciales. Las primeras resumen y describen características de un conjunto de datos, mientras que las segundas permiten hacer generalizaciones sobre poblaciones más amplias.

Un modelo estadístico busca explicar el “por qué” detrás de los datos. Cuando construyes una regresión lineal en Python, no solo predices valores futuros, sino que entiendes cómo cada variable independiente afecta la dependiente.

La interpretabilidad es fundamental en estadística. Cada coeficiente tiene un significado, cada valor p cuenta una historia sobre la significancia de tus hallazgos.

💡 Si te apasiona el mundo de los scripts y quieres descubrir cómo automatizar tareas desde la línea de comandos, te invito a conocer mi trayectoria personal programando en shell, donde comparto trucos prácticos y lecciones aprendidas que transformaron mi forma de trabajar con sistemas Unix y Linux.

Machine Learning: La Búsqueda de Precisión Predictiva

El aprendizaje automático es una rama de la ciencia de la computación enfocada en desarrollar algoritmos que permiten a las computadoras aprender patrones y tomar decisiones basadas en datos, sin programación explícita.

A diferencia de la programación tradicional donde especificas cada instrucción, los modelos de machine learning identifican patrones automáticamente analizando grandes volúmenes de información.

Existen tres tipos principales de machine learning: supervisado, no supervisado y por refuerzo. Cada uno aborda problemas diferentes con enfoques distintos.

En el aprendizaje supervisado, entrenas modelos con datos etiquetados donde cada entrada tiene su salida correspondiente. Es perfecto para tareas de clasificación y regresión, como detectar spam en emails usando scikit-learn.

El aprendizaje no supervisado trabaja con datos sin etiquetas explícitas. El modelo descubre patrones ocultos o estructuras dentro de la información, ideal para clustering y análisis de asociaciones.

¿Has usado K-means en Python para agrupar clientes similares?

El aprendizaje por refuerzo entrena modelos mediante interacción con un entorno, recibiendo recompensas o penalizaciones. Es la base de sistemas autónomos, robótica y agentes que juegan videojuegos.

La Diferencia Fundamental: Objetivos Opuestos

La mayor diferencia entre estadísticas y machine learning radica en sus propósitos fundamentales. Esta distinción no es solo académica, tiene implicaciones prácticas enormes para tus proyectos en Python.

Los modelos estadísticos están diseñados para inferencia sobre las relaciones entre variables. Buscan responder preguntas como: ¿qué factores influyen en las ventas? ¿Cuánto impacta cada variable?

Por otro lado, los modelos de machine learning están diseñados para hacer las predicciones más precisas posibles. La pregunta clave es: ¿qué va a suceder?

Considera el ejemplo de scoring crediticio. Un enfoque estadístico construiría un modelo mostrando exactamente cómo el ingreso, historial crediticio y ratios de deuda influyen en el riesgo de impago.

Un enfoque de machine learning desplegaría redes neuronales que logran alta precisión predictiva para el riesgo de impago, pero no pueden explicar fácilmente por qué se tomaron decisiones específicas.

¿Necesitas explicar tus predicciones a un comité regulatorio o solo maximizar la precisión?

💡 Si estás dando tus primeros pasos en inteligencia artificial o buscas optimizar tu flujo de trabajo, descubrir cuál es la librería más recomendada para tus proyectos de ML puede ahorrarte semanas de prueba y error, además de acelerar significativamente el desarrollo de tus modelos predictivos.

Statistical Learning: El Puente Entre Dos Mundos

El aprendizaje estadístico es un concepto crucial que efectivamente conecta las estadísticas y el machine learning. Representa un enfoque específico del aprendizaje automático que se enfoca en entender por qué funcionan los modelos.

Esta disciplina no solo pregunta “¿funciona este modelo?” sino también “¿por qué funciona?, ¿cuándo es confiable?, ¿qué tan seguros podemos estar de sus predicciones?”

El statistical learning aplica teoría estadística establecida y marcos matemáticos rigurosos para validar modelos de machine learning. Es especialmente importante cuando trabajas con modelos complejos en Python.

Por ejemplo, en un sistema de recomendación de películas, el machine learning se enfoca en si las recomendaciones generan engagement del usuario. El statistical learning examinaría adicionalmente por qué funciona el algoritmo.

Analiza las relaciones estadísticas entre características de películas, comportamientos de usuarios y resultados, proporcionando confianza matemática en las predicciones.

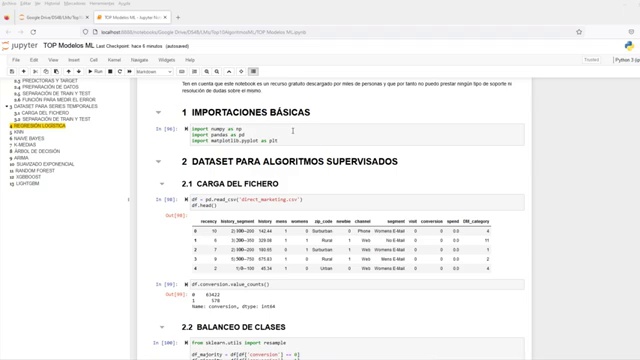

Herramientas en Python: Implementando Ambos Enfoques

Python se ha convertido en el lenguaje dominante para ambas disciplinas. Las bibliotecas disponibles reflejan esta dualidad entre estadística y machine learning.

Para análisis estadístico tradicional, tienes bibliotecas como:

- statsmodels: Proporciona clases y funciones para estimación de modelos estadísticos, pruebas de hipótesis y exploración de datos

- scipy.stats: Ofrece distribuciones de probabilidad, pruebas estadísticas y funciones para inferencia

- pingouin: Simplifica análisis estadísticos comunes con una sintaxis intuitiva

Para machine learning, las opciones son igualmente robustas:

- scikit-learn: La biblioteca estándar para ML clásico con implementaciones de algoritmos supervisados y no supervisados

- TensorFlow y PyTorch: Frameworks para deep learning y redes neuronales complejas

- XGBoost y LightGBM: Implementaciones optimizadas de gradient boosting para predicciones de alta precisión

¿Notas cómo las herramientas reflejan los objetivos diferentes?

Cuándo Usar Estadísticas vs Machine Learning

Elegir entre un enfoque estadístico o de machine learning depende de tus objetivos específicos, el tamaño de tus datos y las necesidades de interpretabilidad.

Usa estadísticas cuando:

💡 Si necesitas manipular datos estructurados en tus proyectos, te resultará imprescindible dominar cómo trabajar con archivos JSON en Python, ya que esta habilidad te permitirá leer, escribir y transformar información de forma eficiente en prácticamente cualquier aplicación moderna.

- Necesitas entender relaciones causales entre variables

- Debes explicar y justificar cada decisión del modelo

- Trabajas con datasets pequeños donde la inferencia es más importante que la predicción

- Requieres intervalos de confianza y pruebas de significancia estadística

- El cumplimiento regulatorio exige interpretabilidad completa

Usa machine learning cuando:

- La precisión predictiva es tu prioridad principal

- Tienes acceso a grandes volúmenes de datos para entrenamiento

- Las relaciones en tus datos son demasiado complejas para modelado estadístico tradicional

- Puedes sacrificar interpretabilidad por rendimiento

- Necesitas automatización y escalabilidad en producción

En muchos casos, la mejor solución combina ambos enfoques. Puedes usar análisis estadístico exploratorio para entender tus datos, luego construir modelos de machine learning para predicciones.

Ejemplo Práctico: Predicción de Precios de Viviendas

Veamos cómo difieren los enfoques con un caso real: predecir precios de viviendas en Python.

Enfoque Estadístico

import statsmodels.api as sm

import pandas as pd

# Cargar datos

df = pd.read_csv('housing_data.csv')

# Definir variables

X = df[['area', 'habitaciones', 'antiguedad']]

y = df['precio']

# Agregar constante para el intercepto

X = sm.add_constant(X)

# Ajustar modelo de regresión lineal

modelo = sm.OLS(y, X).fit()

# Ver resumen estadístico completo

print(modelo.summary())Este enfoque te proporciona coeficientes interpretables, valores p, intervalos de confianza y métricas de bondad de ajuste. Puedes decir: “cada metro cuadrado adicional aumenta el precio en X dólares, con 95% de confianza”.

Enfoque Machine Learning

from sklearn.ensemble import RandomForestRegressor

from sklearn.model_selection import train_test_split

from sklearn.metrics import mean_squared_error, r2_score

# Preparar datos

X = df[['area', 'habitaciones', 'antiguedad', 'distancia_centro',

'calificacion_escuela', 'criminalidad']]

y = df['precio']

# Dividir datos

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2)

💡 Si alguna vez te has preguntado cómo modificar variables fuera del ámbito local de una función sin romper tu código, te recomiendo explorar [cómo usar la palabra clave global en Python](/tutoriales-python/palabra-clave-global-en-python/) para dominar el scope de variables y evitar errores comunes que afectan la lógica de tus programas.

# Entrenar modelo

modelo_rf = RandomForestRegressor(n_estimators=100, max_depth=10)

modelo_rf.fit(X_train, y_train)

# Evaluar precisión

predicciones = modelo_rf.predict(X_test)

print(f'R² Score: {r2_score(y_test, predicciones)}')

print(f'RMSE: {mean_squared_error(y_test, predicciones, squared=False)}')Este enfoque probablemente logre mayor precisión predictiva, especialmente con relaciones no lineales complejas. Sin embargo, explicar por qué predice cierto precio es más difícil.

Interpretabilidad vs Precisión: El Dilema Constante

Uno de los trade-offs más importantes en ciencia de datos es el balance entre interpretabilidad y precisión predictiva. Este dilema está en el corazón de la comparación entre estadísticas y machine learning.

Los modelos estadísticos tradicionales como regresión lineal o logística son altamente interpretables. Cada coeficiente tiene un significado claro y puedes explicar exactamente cómo el modelo llega a sus conclusiones.

Por el contrario, modelos de deep learning como redes neuronales profundas pueden lograr precisión asombrosa, pero funcionan como “cajas negras” donde entender el razonamiento interno es extremadamente difícil.

¿Preferirías un modelo que acierta 95% del tiempo pero no puedes explicar, o uno que acierta 85% pero entiendes completamente?

La respuesta depende del contexto. En aplicaciones médicas o financieras donde las decisiones afectan vidas o fortunas, la interpretabilidad puede ser legalmente requerida.

En aplicaciones como recomendación de contenido o reconocimiento de imágenes, la precisión suele ser más importante que entender cada decisión individual.

Afortunadamente, existen técnicas intermedias. Modelos como árboles de decisión o regresión con regularización (Lasso, Ridge) ofrecen balance razonable entre interpretabilidad y rendimiento.

Herramientas modernas como SHAP y LIME también permiten interpretar modelos complejos, aunque no con la claridad de modelos estadísticos tradicionales.

El Tamaño de los Datos Importa

El volumen de datos disponible influye significativamente en qué enfoque es más apropiado para tu proyecto en Python.

💡 Si tu aplicación necesita ejecutar tareas en paralelo sin bloquear el flujo principal, te recomiendo explorar cómo implementar subprocesos múltiples en Python para aprovechar al máximo los recursos del sistema y mejorar significativamente el rendimiento de tus scripts.

Los métodos estadísticos tradicionales funcionan bien incluso con datasets pequeños. Pueden proporcionar inferencias válidas con muestras de cientos o incluso decenas de observaciones, siempre que se cumplan supuestos apropiados.

El machine learning, especialmente deep learning, generalmente requiere grandes cantidades de datos para entrenamiento efectivo. Los modelos complejos tienen millones de parámetros que necesitan datos abundantes para evitar sobreajuste.

Con datasets pequeños, los modelos de machine learning tienden a memorizar los datos de entrenamiento en lugar de aprender patrones generalizables. Esto resulta en pobre rendimiento con datos nuevos.

¿Tienes 100 observaciones o 100 millones?

Si trabajas con datos limitados, los enfoques estadísticos con validación apropiada suelen ser más confiables. Técnicas como validación cruzada y regularización ayudan, pero no reemplazan la necesidad de datos suficientes.

Por otro lado, si tienes acceso a big data, el machine learning puede descubrir patrones complejos que los métodos estadísticos tradicionales no captarían.

Supuestos: Flexibilidad vs Rigor

Los supuestos subyacentes representan otra diferencia fundamental entre enfoques estadísticos y de machine learning.

Los modelos estadísticos clásicos típicamente requieren supuestos específicos: normalidad de residuos, homocedasticidad, independencia de observaciones, linealidad de relaciones. Estos supuestos permiten inferencia válida pero limitan flexibilidad.

Cuando usas regresión lineal en Python con statsmodels, debes verificar estos supuestos mediante gráficos de diagnóstico y pruebas estadísticas. Violaciones pueden invalidar tus conclusiones.

Los algoritmos de machine learning generalmente hacen menos supuestos sobre la estructura de los datos. Random forests, redes neuronales y gradient boosting pueden modelar relaciones no lineales complejas sin especificar forma funcional.

Esta flexibilidad es ventaja y desventaja. Permite capturar patrones complejos, pero también facilita el sobreajuste si no se maneja cuidadosamente.

¿Prefieres un modelo con supuestos claros pero restrictivos, o uno flexible pero potencialmente impredecible?

💡 Si buscas escribir código más limpio y conciso en Python, dominar las expresiones condicionales en una sola línea te permitirá simplificar tus condiciones if-else y hacer que tu código sea mucho más elegante y profesional.

Validación y Confianza en Predicciones

La forma de validar modelos y expresar confianza en predicciones difiere sustancialmente entre estadísticas y machine learning.

En estadística, la validación se basa en pruebas de hipótesis, valores p, intervalos de confianza y criterios de información como AIC o BIC. Estos proporcionan medidas probabilísticas de incertidumbre.

Puedes decir con confianza estadística: “el efecto de esta variable es significativo al nivel 0.05” o “el verdadero valor del parámetro está en este intervalo con 95% de probabilidad”.

En machine learning, la validación se enfoca en rendimiento predictivo mediante métricas como precisión, recall, F1-score, RMSE o AUC-ROC. Se usan técnicas como validación cruzada y conjuntos de prueba separados.

La incertidumbre en predicciones de machine learning es menos directa. Algunos modelos como Gaussian Processes proporcionan intervalos de predicción, pero muchos algoritmos solo dan predicciones puntuales.

Técnicas modernas como dropout en inferencia o ensembles bayesianos intentan cuantificar incertidumbre en modelos de deep learning, pero esto sigue siendo área activa de investigación.

Combinando Lo Mejor de Ambos Mundos

La dicotomía entre estadísticas y machine learning es a menudo falsa. Los profesionales más efectivos combinan herramientas de ambas disciplinas según las necesidades del proyecto.

Un flujo de trabajo típico podría comenzar con análisis exploratorio estadístico usando pandas y seaborn para entender distribuciones, correlaciones y anomalías en tus datos.

Luego podrías aplicar pruebas de hipótesis para identificar variables significativas antes de construir modelos predictivos más complejos.

Para el modelado, podrías comenzar con regresión regularizada (Lasso o Ridge) que combina interpretabilidad estadística con técnicas de machine learning para prevenir sobreajuste.

Si necesitas mayor precisión, podrías avanzar a modelos ensemble como Random Forest o XGBoost, usando técnicas de interpretabilidad como feature importance o SHAP values.

Finalmente, validarías tus modelos usando tanto métricas estadísticas (intervalos de confianza, pruebas de significancia) como métricas de machine learning (precisión en conjunto de validación).

Este enfoque híbrido aprovecha las fortalezas complementarias de ambas disciplinas.

💡 Si quieres llevar tus habilidades al siguiente nivel con ejemplos prácticos que realmente funcionan, te recomiendo explorar una selección curada de proyectos Python desde nivel básico hasta avanzado donde encontrarás casos de uso reales que acelerarán tu curva de aprendizaje de forma exponencial.

El Futuro: Convergencia o Divergencia

El debate sobre estadísticas vs machine learning evoluciona constantemente con nuevas técnicas y aplicaciones.

Observamos tendencias hacia mayor interpretabilidad en machine learning con desarrollo de técnicas como attention mechanisms, explainable AI y modelos causales.

Simultáneamente, las estadísticas incorporan métodos computacionales más sofisticados, incluyendo estadística bayesiana computacional y métodos de Monte Carlo.

El campo emergente del causal machine learning combina inferencia causal estadística con poder predictivo del aprendizaje automático, prometiendo lo mejor de ambos mundos.

¿Veremos eventualmente fusión completa de estas disciplinas?

Probablemente no. Las diferencias fundamentales en objetivos y filosofía persistirán. Pero la colaboración creciente entre estadísticos y científicos de datos enriquece ambos campos.

Para ti como desarrollador Python, esto significa que dominar ambas perspectivas te hace más versátil y valioso. No necesitas elegir un bando, puedes ser bilingüe en estadísticas y machine learning.

Recursos y Siguientes Pasos

Si quieres profundizar en esta comparación de estadísticas y machine learning, hay recursos excelentes disponibles para desarrolladores Python.

Para fundamentos estadísticos, considera “An Introduction to Statistical Learning” que proporciona base sólida con implementaciones en R (fácilmente traducibles a Python).

Para machine learning práctico, “Hands-On Machine Learning with Scikit-Learn, Keras, and TensorFlow” de Aurélien Géron es referencia indispensable con código Python real.

Plataformas como Coursera ofrecen especializaciones que cubren ambas áreas, incluyendo el famoso curso de Machine Learning de Stanford y cursos de estadística inferencial.

Practica con datasets reales en Kaggle donde puedes ver cómo otros abordan problemas usando enfoques estadísticos y de machine learning.

Construye proyectos que te obliguen a considerar ambas perspectivas. Por ejemplo, predice algo importante pero también explica qué factores impulsan tus predicciones.

La maestría real viene de entender cuándo aplicar cada enfoque y cómo combinarlos efectivamente para resolver problemas reales con Python.